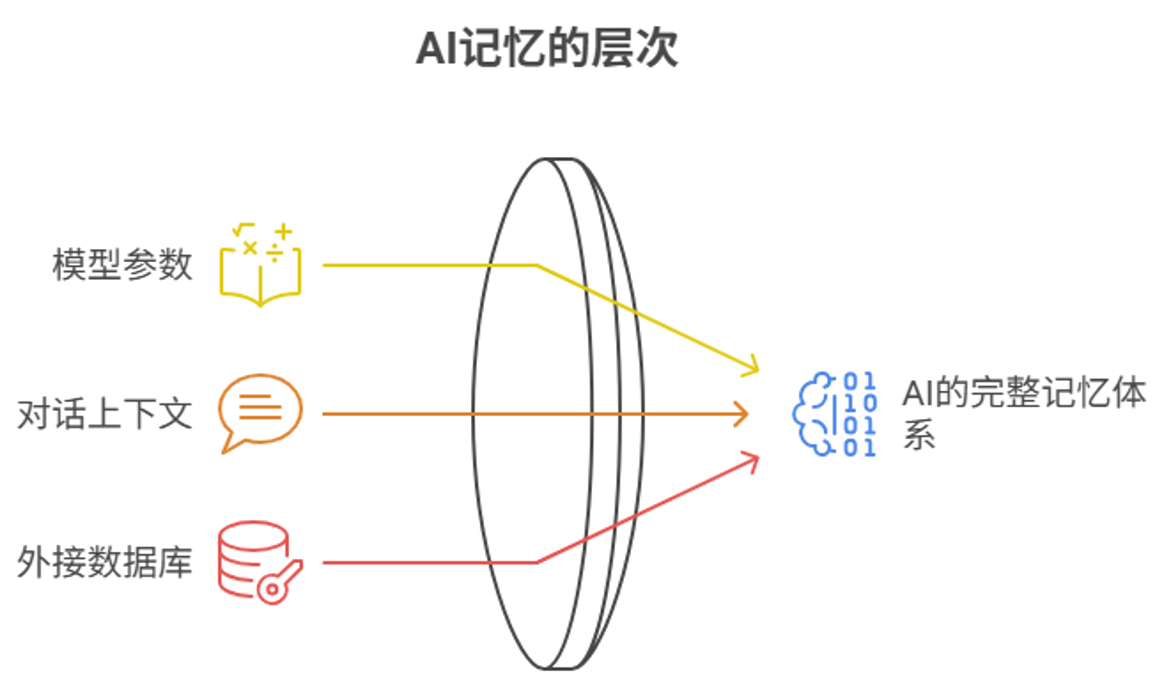

引言:在人工智能的交互中,记忆是让对话连贯、个性化并具备深度的关键。但AI的记忆并非单一形式,而是分为不同的层次和机制。通常,我们可以将AI的记忆分为三类:模型参数里的长期知识、对话长上下文里的短期记忆,以及外接数据库里的可持久记忆。这三种记忆各司其职,共同构成了AI的完整记忆体系。

一、参数记忆:内化的通用知识

参数记忆指的是内化在模型权重中的知识。在预训练或微调阶段,模型通过反向传播将海量数据中的规律和知识压缩到神经网络的参数中。由于训练数据通常覆盖广泛领域,参数记忆基本上是同通用领域的知识。

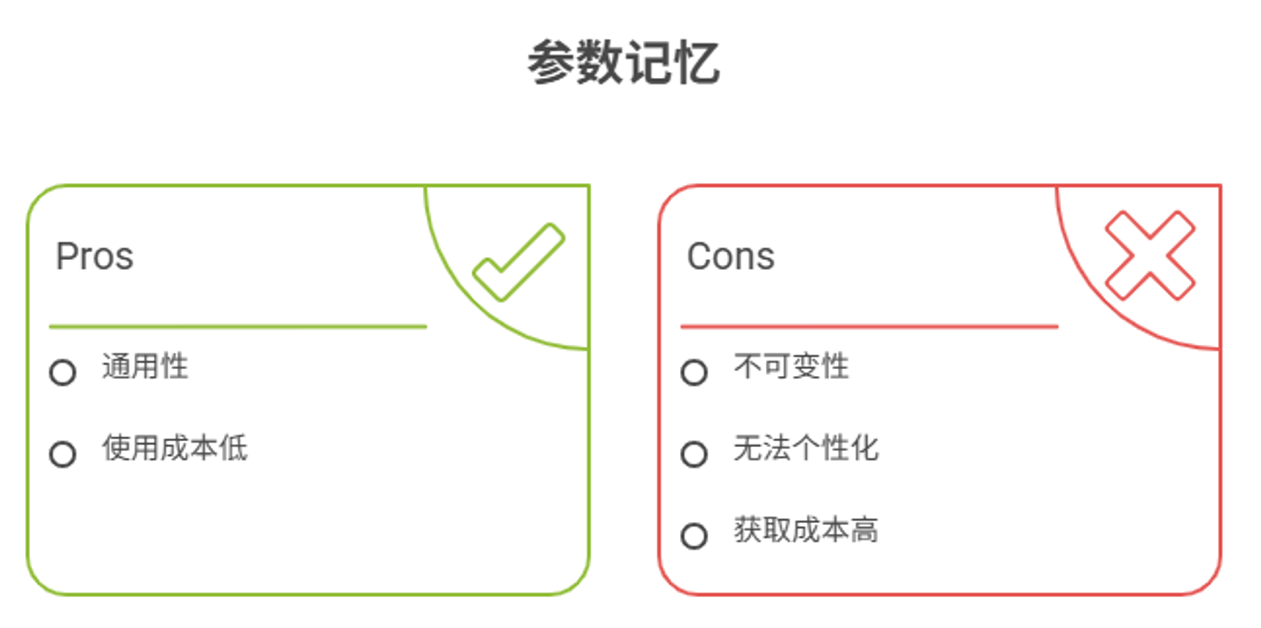

特点:

- 通用性:涵盖训练数据中的普遍知识,例如语言规则、科学常识、文化背景等。

- 不可变性:一旦训练完成,参数记忆相对固定,除非进行额外的微调。

- 无法个性化:由于是通用训练,无法照顾到每一个个体的特定信息和偏好。

- 获取成本高:需要大量计算资源和数据训练,但使用成本低。

参数记忆是AI的“常识库”,但它不包含特定用户的信息,也无法在交互过程中实时更新。就像一本百科全书,所有人都能看到相同的内容。

二、上下文记忆:工作记忆区

上下文记忆通常指的是提示词以及可见的历史对话。它包括用户输入的提示词、系统指令以及工具返回的结果等,是模型在当前轮次推理时能够直接看到并利用的信息集合。这类似于人类的工作记忆,放在一个临时工作区,并不会永久存储。

工作机制:

模型将上下文信息编码成一串Token,在生成响应时参考这些信息。但生成结束后,模型不会把这些信息写回权重。因此,上下文记忆的能力边界在于一次对话的上下文长度。

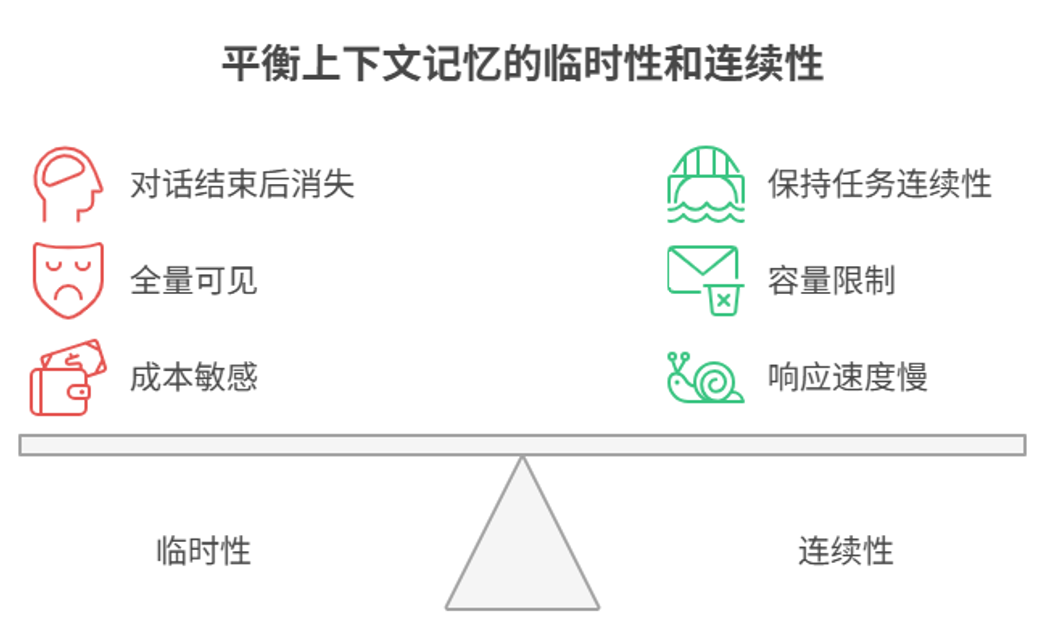

特点:

- 临时性:仅限于当前对话上下文,对话结束后即消失。

- 连续性:擅长保持多轮对话之间的任务连续性。

- 全量可见:上下文中的所有信息都对模型平等可见。

- 容量限制:受限于模型的上下文窗口大小(从几千到几十万Token不等)。

- 成本敏感:长上下文意味着更高的计算成本和更慢的响应速度。

上下文记忆是AI处理当前对话的“草稿纸”,但它的容量有限,且无法持久。更重要的是,当对话足够长时,我们就需要上下文压缩技术来智能地管理这些信息。

三、上下文压缩:智能记忆管理

当对话内容超出模型的上下文窗口时,我们需要上下文压缩技术。这就像是人类的会议记录——不会逐字记录,而是提取关键信息。

为什么需要压缩?

- 容量限制:所有模型都有最大上下文长度

- 性能衰减:模型对早期信息的关注度会下降

- 成本控制:处理长上下文成本高昂

- 焦点保持:太多历史信息会分散注意力

压缩策略:

- 摘要压缩:将长对话提炼为简短摘要

- 选择性保留:只保留关键事实、决定和偏好

- 结构化提取:将非结构化对话转为结构化数据

- 分层管理:构建金字塔式的记忆结构

通过智能压缩,AI能够在有限的上下文窗口内保持对话的连贯性和关键信息的可用性。

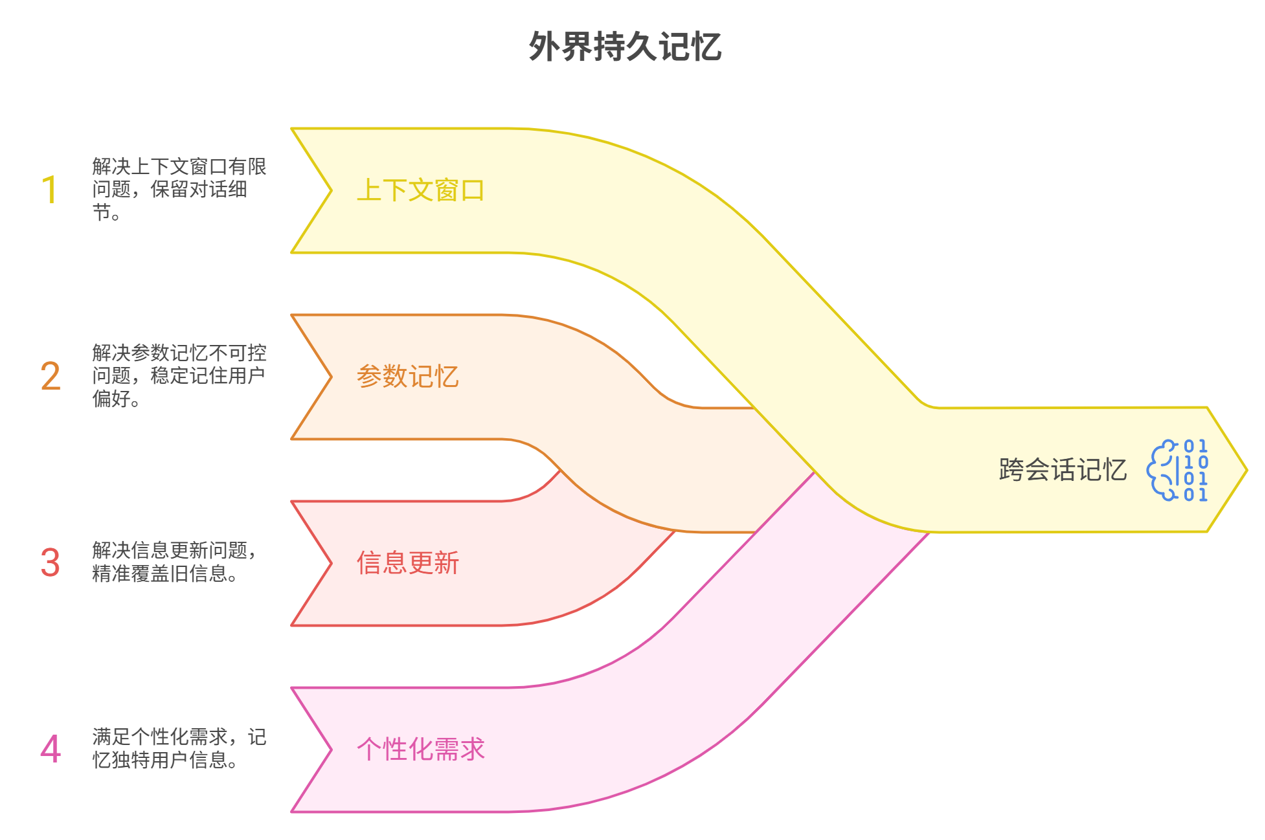

四、外接持久记忆:可扩展的个人化记忆

外接数据库里的持久记忆,解决了参数记忆和上下文记忆无法克服的核心问题:

- 上下文窗口有限:对话一长就会丢失细节。

- 参数记忆不可控:很难让模型稳定记住某个用户的偏好,也很难精准删除某条记忆。

- 信息需要更新:当信息发生变更时,新信息需要精准覆盖旧信息。

- 个性化需求:每个用户都有独特的信息需要记忆。

外部记忆系统将需要记住的信息抽取出来长期保存,并在需要的时候精准取回。这样,AI就可以拥有跨会话、可更新、可管理的记忆。

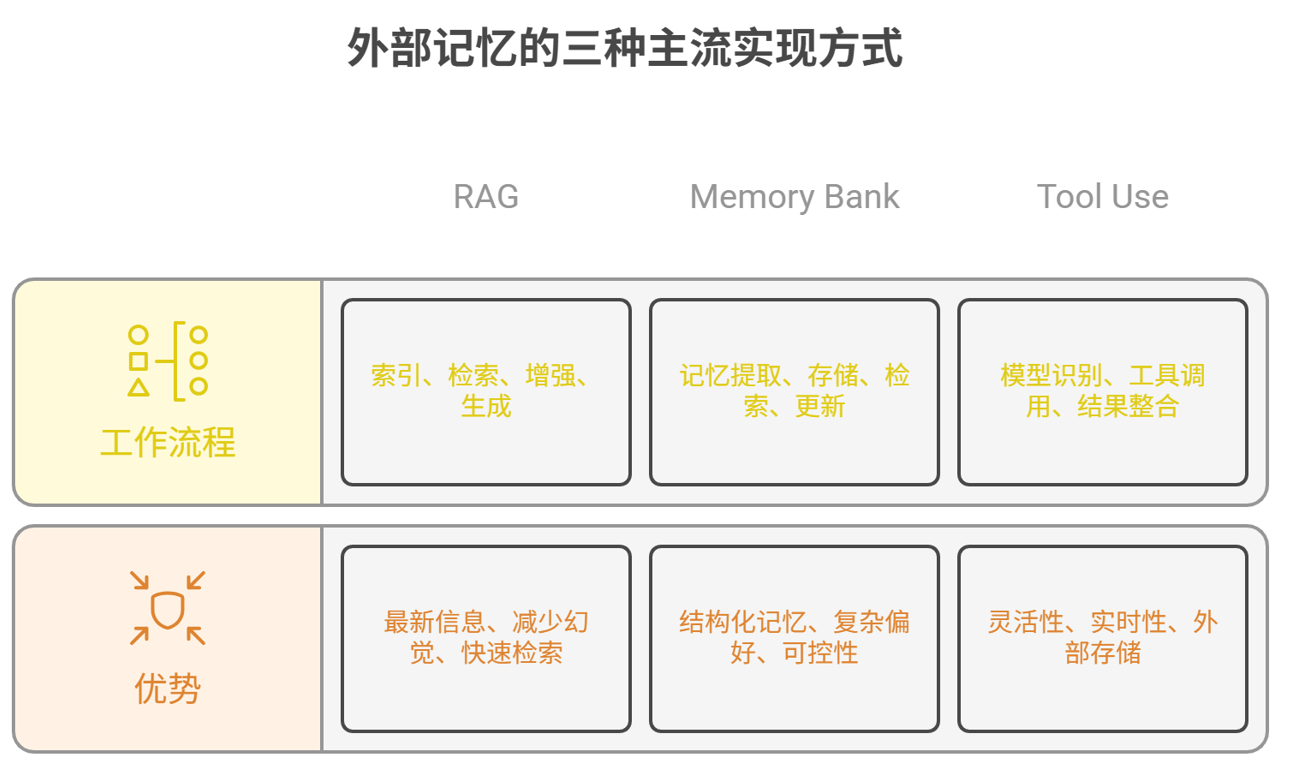

外部记忆的三种主流实现方式:

1. RAG(检索增强生成)

RAG是目前最成熟的流派。它通过将外部知识库与生成模型结合,在生成响应时先检索相关文档,然后将检索结果作为上下文提供给模型,从而生成更准确、更相关的回答。

工作流程:

- 索引:将文档转换为向量并存储在向量数据库中。

- 检索:根据用户查询,检索最相关的文档片段。

- 增强:将检索到的文档作为上下文与用户查询一起输入模型。

- 生成:模型基于增强的上下文生成回答。

优势:

- 可以利用最新的、非训练时的信息。

- 减少模型产生幻觉(编造信息)的可能。

- 支持大规模知识库的快速检索。

2. Memory Bank(记忆库)

Memory Bank是一种结构化的记忆存储,将对话中的关键信息以结构化的方式存储在外部数据库中。当需要时,通过查询记忆库来获取相关信息。

工作流程:

- 记忆提取:从对话中提取关键信息。

- 记忆存储:以结构化的形式存储在数据库中。

- 记忆检索:根据当前对话的上下文,检索相关的记忆。

- 记忆更新:随着对话进行,更新或添加新的记忆。

优势:

- 记忆结构化,便于精确查询和更新。

- 可以存储复杂的用户偏好和关系。

- 支持记忆的增删改查,可控性强。

3. Tool Use(工具调用)

通过让模型调用外部工具来获取或存储信息,从而扩展模型的记忆和能力。模型可以主动使用工具来记录信息或查询信息。

工作流程:

- 模型识别需要外部工具的任务。

- 调用相应的工具API。

- 将工具返回的结果整合到上下文中,并生成回答。

优势:

- 灵活性高,可以集成各种工具。

- 实时性,可以获取最新信息。

- 可以将记忆存储到任何外部系统中。

结语:让AI记忆成就深度对话

AI的记忆机制是其从简单的问答工具转变为智能伙伴的关键。通过理解参数记忆、上下文记忆和外部持久记忆的各自特点与协同方式,我们可以设计出更强大、更个性化的AI应用。

特别是当我们需要处理长对话时,上下文压缩技术成为必不可少的工具,它让AI能够在有限的资源下保持对话的深度和连贯性。