引言:如果说大语言模型是对人类大脑的模拟,那么如何让这个“大脑”连接并控制“手脚”,过去两年一直是行业里最混乱的领域。在 MCP(Model Context Protocol,模型上下文协议)出现之前,我们始终在用一种原始、碎片化的方式解决连接问题。这一由 Anthropic(Claude 的母公司)于 2024年11月25日开源发布的协议,目标正是为大模型与外部世界建立一个标准化、安全的“万能插座”。

一. 协议的必然:从“私约”到“总线”

所有技术演进,最终都会走向协议化。

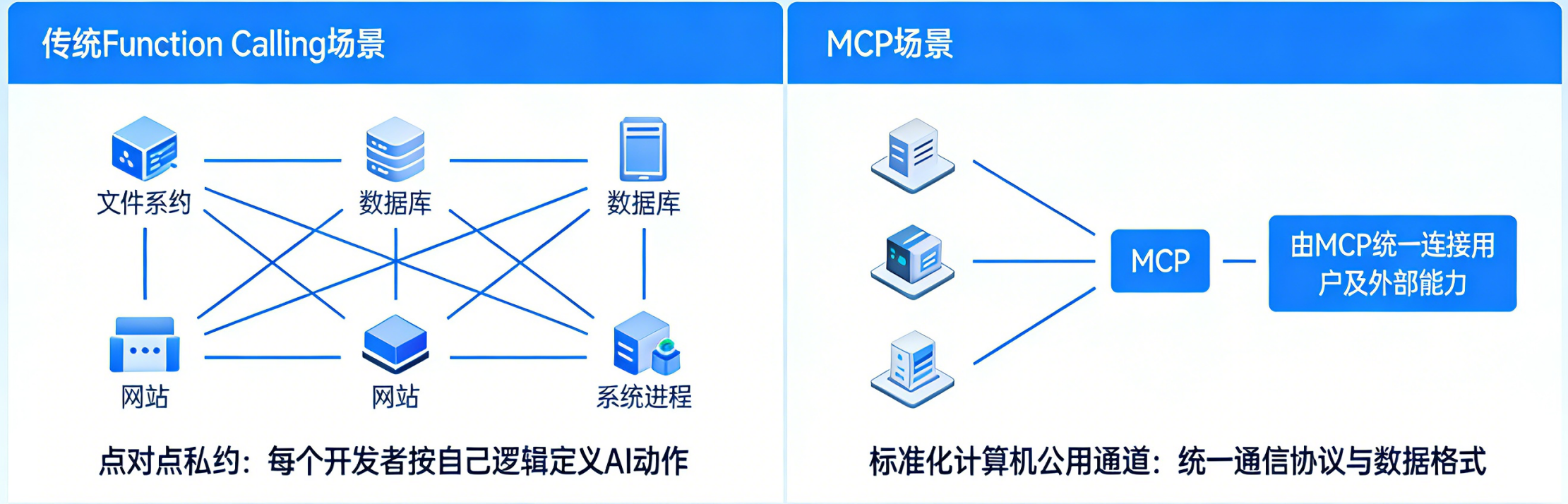

传统的 Function Calling 实际上是一种“点对点私约”,每个开发者都按自己的逻辑定义 AI 动作。这种方式在简单场景中有效,可一旦你的智能体需要同时处理文件系统、数据库、网站与系统进程,系统复杂度便呈指数级上升。

MCP 的出现,终结了这种碎片化。它通过一套统一的通信协议与数据格式,将连接能力从模型层剥离出来。它不再要求模型适配每一个工具,而是建立了一套通用标准。只要符合协议,任何模型都可以像插拔 U 盘一样,随时调用任何外部能力。这种从“点对点私约”到“标准化总线”的转变,是 AI 走向工程化成熟的标志。

二. 核心架构:客户端-服务器模型如何工作

Function Calling 是局部的,它属于某个特定应用或某段代码。而 MCP 是全局的,其力量正源于它清晰的客户端-服务器(Client-Server)架构。

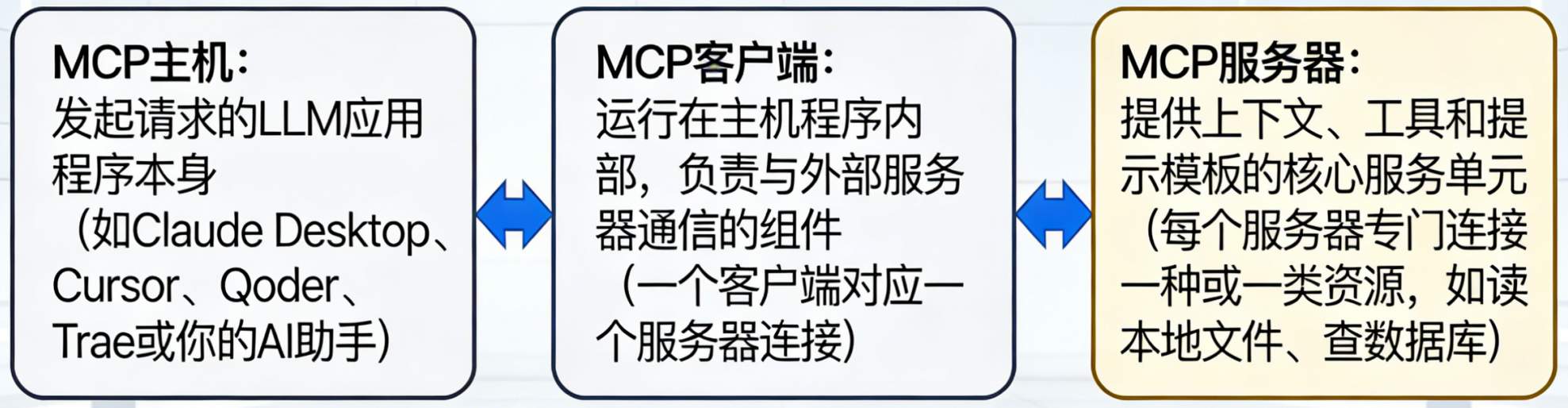

在这个架构中,主要有三个角色协同工作:

- MCP 主机:即发起请求的 LLM 应用程序本身,例如 Claude Desktop、Cursor、Qoder、Trae 或你的 AI 助手。

- MCP 客户端:运行在主机程序内部,负责与外部服务器通信的组件。一个客户端对应一个服务器连接。

- MCP 服务器:提供上下文、工具和提示模板的核心服务单元。每个服务器都专门连接一种或一类资源,例如一个服务器专门读本地文件,另一个专门查数据库。

它的工作流程简洁而高效:

- 初始化连接:当主机应用需要某种能力时,其内部的 MCP 客户端会向对应的 MCP 服务器发起连接。

- 发送请求:客户端根据需求(如“读取某文档”或“查询数据库”)构建标准化请求,发送给服务器。

- 处理请求:服务器解析请求,安全地访问其连接的资源——无论是本地文件、数据库,还是通过API连接的 外部接口——并执行相应操作。

- 返回结果:服务器将获取的结果封装成标准响应,送回客户端,最终呈现给模型和用户。

- 断开连接:任务完成后,连接可被安全关闭。

这种分层设计的直接好处是安全、可控与复用。数据资源被封装在独立的服务器后,访问权限得以精细控制。同时,一个服务器(如公司数据库服务器)可以被多个不同的 AI 应用(主机)共享,彻底实现了能力的解耦与复用。

三. 被低估的“上下文”深度:不仅是工具,更是感官

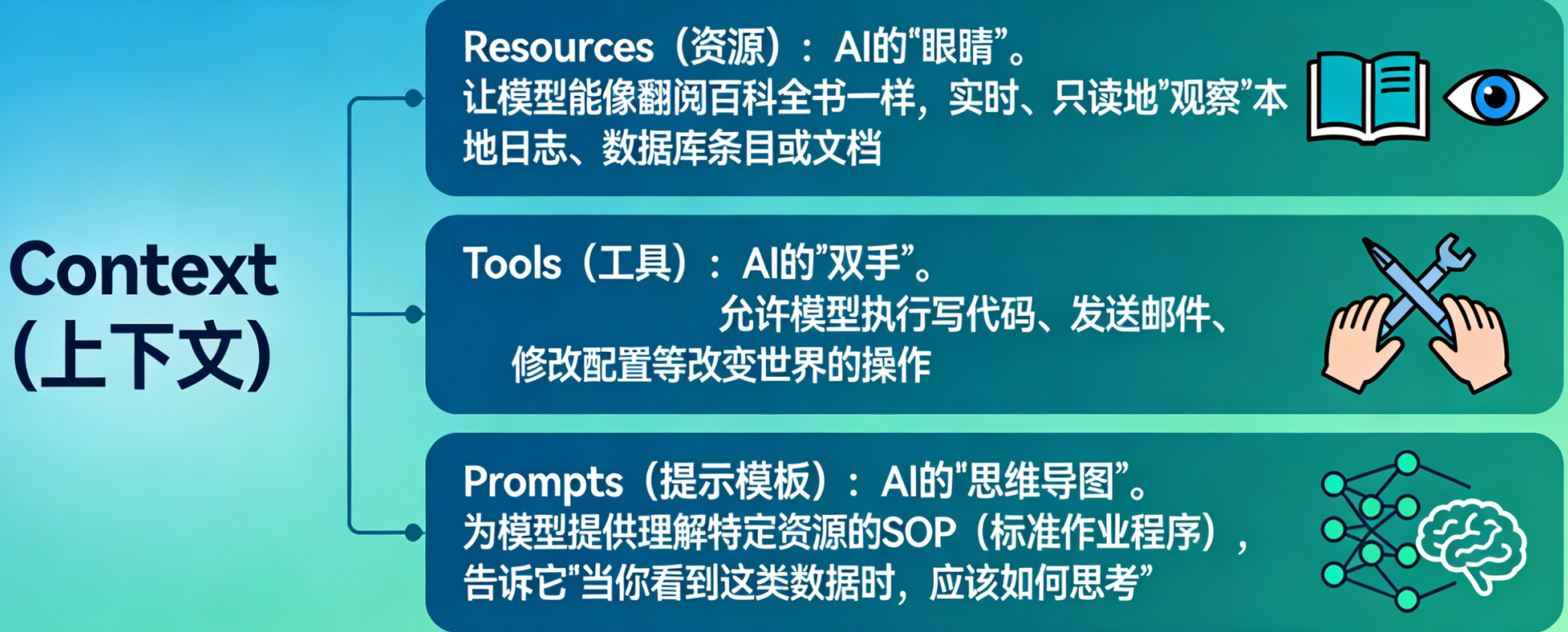

许多人误以为 MCP 只是 Function Calling 的升级版,其实它的命名直指核心:Context(上下文)。该协议系统性地定义了三个维度,构建了 AI 的立体感官:

- Resources(资源): AI 的“眼睛”。让模型能像翻阅百科全书一样,实时、只读地“观察”本地日志、数据库条目或文档。

- Tools(工具): AI 的“双手”。允许模型执行写代码、发送邮件、修改配置等改变世界的操作。

- Prompts(提示模板): AI 的“思维导图”。为模型提供理解特定资源的 SOP(标准作业程序),告诉它“当你看到这类数据时,应该如何思考”。

这种获取上下文的主动权,让 AI 从一个“被动等待指令的对话框”,进化为能在授权范围内主动“观察”并“理解”环境的数字实体。

四. AI 的总线时代:生态决定未来

计算机架构最重要的发明之一是总线。它让 CPU、内存、硬盘高效协同,而无需了解彼此物理细节。

MCP 旨在成为 AI 时代的标准总线。我们正从“调模型”的阶段,走向“筑生态”的阶段。未来的竞争力不在于你用的模型有多大,而在于你拥有或能连接多少高质量的 MCP Server。这些服务器——作为通往本地数据与云端服务的标准化接口——决定了 AI 触达并改变现实世界的深度与广度,也决定了它从对话机器人进化为真正数字实体的速度。

结语:通往智能万物的接口

协议的统一,是所有大规模工业化的先决条件。MCP 通过标准化的客户端-服务器架构,在模型与万物之间建立了安全、双向的连接通道。

当模型可以无缝切换,工具、数据与能力能够如同组件般即插即用,AI 才真正具备了作为下一代生产力通用底座的资格。它不再是一个需要被反复“集成”的黑盒,而是一个拥有标准化扩展接口的“通用插座”。这,或许就是我们正在见证的、AI 基础设施最重要的演进方向。